Gli scienziati della divisione asiatica di Microsoft Research hanno collaborato con i colleghi dell’Institute of Computing Technology alla Chinese Academy of Sciences per implementare un sistema che sfrutta le funzioni di Kinect per riconoscere la lingua dei segni, la lingua impiegata dai non udenti e dalle persone aventi problemi di udito.

Attualmente, infatti, esistono interpreti, seppur in numero limitato, della lingua dei segni ma non risulta disponibile alcuna tecnologia che consente di interagire direttamente con i computer. Anche se nel corso degli anni i ricercatori hanno esaminato a più riprese svariate tipologie di input (guanti, videocamere tec.) nessuno di essi si è rivelato la soluzione più adatta.

Il Kinect, invece, consente ai non udenti di interagire in maniera naturale, o quasi, con il computer presentando inoltre un costo decisamente ben più contenuto rispetto a tutte le altre tecnologie.

Sfruttando la funzionalità di motion tracking del Kinect la lingua dei segni viene tradotta utilizzando i movimenti delle dita, della mano e del corpo oltre, ovviamente, alle espressioni del viso.

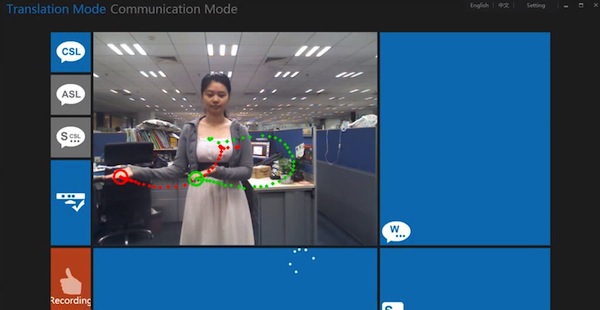

Il software sviluppato dai ricercatori asiatici può essere impiegato attivando una delle due modalità di funzionamento supportate, quali la Translation Mode e la Comunications Mode.

Attivando la prima modalità la lingua dei segni viene tradotta in testo o voce. Da notare che al momento è supportata soltanto la ASL, la lingua dei segni americana, ma in futuro saranno aggiunte tutte le varianti.

Attivando invece la seconda modalità è possibile avviare una conversazione tra una persona normo-udente ed una persona non udente. Un avatar sullo schermo del computer mostra infatti i segni corrispondenti al testo e la persona non udente ha la possibilità di rispondere con i segni che vengono a loro volta convertiti in testo.

[Photo Credits | YouTube]

Via | Neowin